عصر ما بعد «جوجل»: إخفاق البيانات الضخمة وصعود تكنولوجيا «بلوك شين»

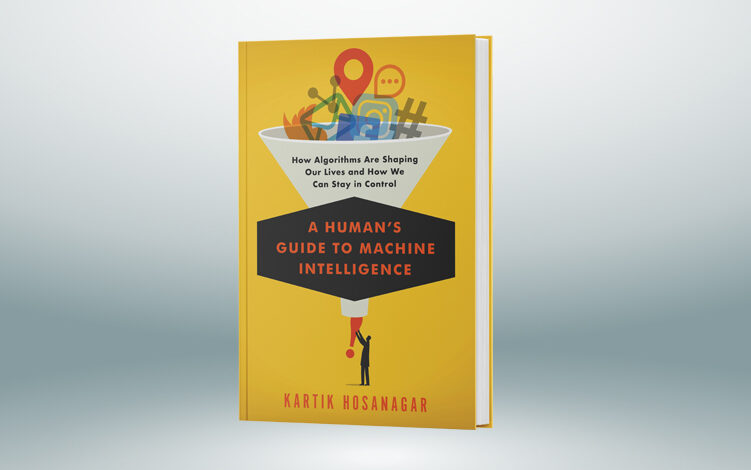

الكتاب: “عصر ما بعد “جوجل”: إخفاق البيانات الضخمة وصعود تكنولوجيا “بلوك شين“.

المؤلف: كارتيك هوسناجار .

الناشر: Viking

عدد الصفحات: 272 صفحة.

تاريخ النشر: 12 مارس 2019

اللغة: الإنجليزية

يستكشف كتاب البروفيسور “كارتيك هوسناجار“، الأستاذ في كلية “وارتون” من خلال كتاب “دليل الإنسان إلى ذكاء الآلة” كيف أن الخوارزميات والذكاء الاصطناعي الذي يكمن وراءها قد تسربا إلى حياتنا، حيث تسللا إلى مجالات صنع القرار التي كانت ذات يوم المحمية الوحيدة للبشر.

ونظرًا لأنه يصعب تحديد ذلك بدقة، فربما لم تلاحظ حتى الآن مدى تأثر حياتنا بالخوارزميات التي تتخذ القرارات اليومية نيابة عنا بدءًا من المنتجات التي نشتريها، إلى حيث نقرر تناول الطعام، وحتى كيف نستقبل الأخبار.

وحاليًا هناك آلة تخبرك بالوقت الذي ستحتاجه للوصول إلى وجهتك، ونوع الموسيقى التي يجب أن تستمع إليها، وكلها أمثلة غير ضارة نسبيًا.

وفي الوقت الذي تقوم فيه بالتصفح عبر موجز الأخبار الخاص بك على فيسبوك مثلاً، تقوم خوارزمية أخرى في مكان ما بتوفير إرشادات تشخيصية للأطباء قائمة على الذكاء الاصطناعي، وأخرى تساعد القائمين على التوظيف وعلى تقديم قائمة مختصرة من المتقدمين للوظائف.

وغيرها تقرر قبول المتقدمين للالتحاق بالجامعة، وأخرى تطبق العدالة الجنائية، واضعين بذلك نهاية للطرق القديمة لصنع القرار.

وبحسب “هوساناجار” فإن برامج الكمبيوتر المصممة “المساعد الصوتي “خصيصًا لمحاكاة المحادثة مع المستخدمين عبر الإنترنت”Chatbots” مثل “سيري” و”أليكسا” قد تكون في النهاية مجرد بوابات يمكننا من خلالها الوصول إلى المعلومات والمعاملات عبر الإنترنت.

ولكن بعض الشركات تأمل حاليًا في استخدام برامج الدردشة الآلية تلك لاستبدال عدد كبير من موظفي خدمة العملاء لديها، على سبيل المثال كمساعدين للتسوق من خلال قيام مثل تلك الآليات بجمع المعلومات حول أذواقنا في الملابس، وتقييمها، واتخاذ قرارات الشراء نيابة عنا.

ولذلك نحتاج إلى تسليح أنفسنا بفهم “أفضل وأعمق وأكثر دقة” لظاهرة التفكير الخوارزمي. كما يشير إلى المخاطر الكامنة من خلال تسليط الضوء على مخاطر تلك القضية كحادثة إفساد البرنامج الآلي للدردشة الخاص بتويتر في فترة زمنية أقل من 24 ساعة.

كما يتناول الكتاب كيف كشفت شركة مايكروسوفت عن روبوت “تاي” وعمله على تويتر ووصفته الشركة بأنه تجربة في “فهم المحادثة”. وقالت مايكروسوفت إنه كلما تحدث المستخدمون مع “تاي” أصبح أكثر ذكاءً وأكثر قدرة على تعلم التواصل والاشتراك مع الناس من خلال “محادثات غير رسمية ومرحة”.

ولكن للأسف، المحادثات لم تبق مرحة لفترة طويلة . فبعد فترة وجيزة من إطلاق “تاي”، بدأ الناس في ضخ تغريدات تتضمن كل أنواع التصريحات المجنونة والمحملة بالكراهية والتي تتسم بالعنصرية. وبالتالي قام “تاي”، كونه أساسًا محض ببغاء متصل بالإنترنت، بتكرار بث هذه المشاعر مرة أخرى للمستخدمين.

وبحسب المؤلف فإن “مايكروسوفت” لم تتوقع أن يقوم “تاي” بتطوير شخصية عدوانية بهذه السرعة المقلقة، كما يقول “هوساناجار”: “إن الخوارزمية التي تسيطر على الروبوت فعلت شيئًا لم يتوقعه أي شخص قام ببرمجتها، فقد استغرقت في حياة خاصة بها”.

مقعد القيادة

وفي نهاية المطاف، أغلقت “مايكروسوفت” موقع المشروع، وأدرج معهد “ماساتشوستش” للتكنولوجيا “تاي” في تصنيفه السنوي على أنه الأسوأ في مجال التكنولوجيا.

وتنطوي نظرية “هوساناجار” حول الخوارزميات على بعض التحليلات العميقة للتكنولوجيا الجديدة التي قمنا ببنائها، والتي أصبحت الآن تقيدنا من غير قصد.، حتى وصل الموضوع إلى بعض القرارات التي اتخذها الأطباء والطيارون والقضاة في بعض الأحيان.

وبصورة صادمة فإن الخوارزميات، رغم كل ما وعدت به من حياد، يمكن أن تؤدي إلى نتائج متحيزة. ولطالما كان الباحثون قلقين بشأن عدالة الخوارزميات. على سبيل المثال، اتضح أن محرك التوظيف القائم على موقع أمازون قد رفض المرشحات من النساء لوظائف مطوري البرمجيات والوظائف الفنية الأخرى.

وذلك لأن طرازات الحواسيب في أمازون قد تم تدريبها على فحص المتقدمين من خلال مراقبة الأنماط في السير الذاتية المقدمة إلى الشركة خلال فترة عشر سنوات جاء معظمها من الرجال، وهو ما يعكس هيمنة الذكور في جميع أنحاء صناعة التكنولوجيا.

وبذلك يؤكد مؤلف كتاب “دليل الإنسان إلى ذكاء الآلة” على أن احتمال التمييز معقد بسبب التعقيد الرياضي للخوارزميات، فقد يكون من الصعب تتبع الحساب الذي يحول المدخلات إلى مخرجات، مما أدى إلى وصف الخوارزميات بأنها “صناديق سوداء”.

لكن مع وجود القواعد الصحيحة المعمول بها يمكن أن تكون الخوارزميات أكثر شفافية من الإدراك البشري وهو ما يمكن أن يجعل من السهل اكتشاف ومنع التمييز، شريطة بقاء الإنسان في “مقعد القيادة” أو التحكم وليس الآلة.